Innodisk丨强悍加速,智启边缘:Apex X100-Q 震撼登场

供稿:宜鼎国际股份有限公司

基于 Intel 架构的 AI 系统,搭载 Qualcomm Cloud AI 100 Ultra 加速器

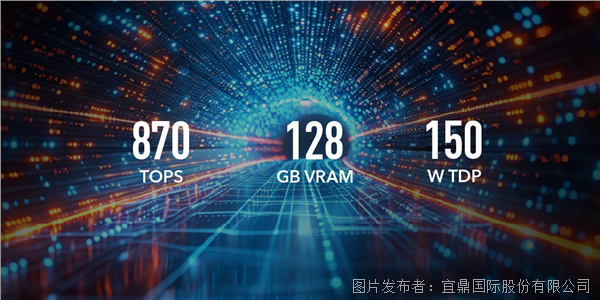

●提供高达 870 TOPS 的强劲算力,配备 128GB LPDDR4x 内存,全面支持小语言模型(SLM)、大语言模型(LLM)及生成式 AI 应用

●搭载Intel 第 13 代 Core i7 处理器、192GB 系统内存及 2TB SSD

●兼具强大 AI 计算性能与 150W 低功耗优势

1、计算平台提供高达 870 TOPS (INT8) 的计算性能。

2、内存模块支持至多 4 个宜鼎 DDR5 4400 UDIMM 内存模组,提供最高 192GB 容量。

3、嵌入式存储内置 1 个宜鼎工业级 M.2 4TG2-P2TB SSD,支持 PCIe Gen4 x4 接口。

4、带外管理内置带外(OOB)远程管理模块。

5、I/O 接口配备 3 个 2.5G RJ45 LAN 接口、1 个 10G RJ45 LAN 接口、1 个 USB 3.2 Gen2x2(20Gbps)Type-C 接口、8 个 USB 3.2 Gen2 接口以及 2 个 DP++ 接口。

接口配置

1,电源按钮

2,音频输出

3,麦克风输入

4,COM端口(RS-485,RJ45接口)

5,USB Type C(3.2 Gen 2 x2)

6,2.5G LAN(支持30W PoE)

7,USB 3.2 Gen 2 x1

8,2.5G LAN

9,HDMI

10,DP++

11,DIO

12,COM端口(RS-232 / 422 / 485)

13,电源输入

为卓越性能而打造

APEX-X100-Q 搭载 Qualcomm Cloud AI 100 Ultra 加速器,专为小语言模型(SLM)、大语言模型(LLM)及生成式 AI 应用而设计。

顶尖计算能力

APEX-X100-Q 提供强劲的计算性能,内置 Qualcomm 最新一代 Cloud AI 100 Ultra 加速器,支持高达 870 TOPS(INT8)算力和 128GB VRAM,整机功耗仅 150W TDP,非常适用于本地化部署的企业级大语言模型(LLM)及多模态 AI 应用。

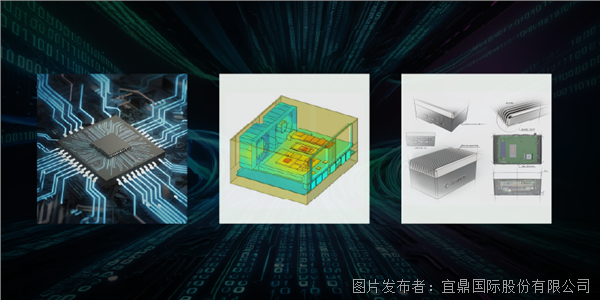

独家机箱设计

机壳采用上掀式结构,不同于传统螺丝固定方式,通过独家钥匙孔设计即可轻松开启机箱,方便更换内部组件及进行系统维护。

多元 I/O 扩展

配备 3个 2.5G RJ45 LAN 接口、1个 10G RJ45 LAN 接口、1个USB 3.2 Gen 2 x2(20Gbps)Type-C 和 8个 USB 3.2 Gen 2 接口,实现高速数据传输。

高兼容模块选择

除内置选项外,宜鼎还提供完整的工业级 SSD、DRAM 模块和嵌入式外设模块,并支持定制化选项,灵活满足客户多样化的应用需求。

优异定制化服务

宜鼎以灵活的合作模式,提供定制化 AI 系统服务。除初始内置的 AI 加速卡外,还可提供多种替代方案供客户灵活选择。此外,还可根据客户需求,提供软硬件、固件、BIOS、I/O、散热解决方案及系统设计等定制化服务。

探索多元应用场景与成功实例

APEX-X100-Q:为人工智能驱动的呼叫中心提供支持

APEX-X100-Q 搭载 Qualcomm Cloud AI 100 Ultra 加速器,可提供 870 TOPS (INT8) 算力、128 GB VRAM 和 150 W TDP,提供经济高效的高性能解决方案。它专为本地多模态语言模型而设计,支持语音转文字应用,为 AI 驱动的自动呼叫中心提供支持。