Intel® Xeon® 6980P Processor---超强算力破壁者

供稿:世平集团

Intel® Xeon® 6 processor

今天的主角是 Intel® Xeon® 6980P Processor,这款专为超算和 AI 训练设计的旗舰级产品曾经也是创下了英特尔 CPU 的历史价格纪录。但是,它的出名,不单是因为它超高的价格,更是因为它出道即巅峰的性能。

在 Intel® Xeon® 系列从单核到 Chiplet 的二十余年进化中,6980P 绝非简单的参数堆砌。这款 128 核旗舰处理器以 “密度突破 + AI 原生 + 内存革命” 的三重基因,重新定义了企业级 CPU 的性能天花板。它不仅延续了至强 6 系列 “性能核 + 能效核” 的架构优势,更在大模型推理、高密度计算等场景实现质的跨越,成为打破 “GPU 垄断高端 AI 算力” 的关键力量。

一、架构密度革命:128 核 Chiplet 设计的算力压缩术

Xeon® 6980P 的核心突破始于架构重构,通过先进 Chiplet 技术实现 “高密度与高能效的平衡”,这是对上一代 6900P 的跨越式升级。

1. 芯粒集成的极限密度

其采用 3 颗计算芯粒(Chiplet)互联设计,每颗芯粒屏蔽 1-2 个内核后实现 128 核总规模,通过优化的网格布局(每芯粒 44 核 + 6 个内存控制器网格)解决良率难题。这种设计使单芯片核心数较第五代(最高 64 核)直接翻倍,256 线程的并行处理能力让单路服务器可承载 10 倍于传统机型的容器实例,机架算力密度提升至 5PFlops/U。

2. 能效比的精准调控

尽管核心数飙升,其通过 Intel 3 工艺与智能功耗分配技术,将 TDP 控制在 500W,实现 “每瓦性能较上代提升 1.6 倍”。在双路部署场景中,处理同等数据库负载时,总功耗较Xeon® 8380 降低 22%,助力微软 Azure 等云厂商达成碳中和目标,延续了Xeon® 系列 “绿色算力” 的进化轨迹。

二、AI 算力跃迁:纯 CPU 驱动超大规模模型的破局者

Xeon® 6980P 彻底改写了 “CPU 只能做 AI 推理辅助” 的认知,凭借 AMX 指令集与软件优化,成为超大规模语言模型的独立算力载体。

1. 指令集与框架的深度协同

其内置的 Advanced Matrix Extensions(AMX)加速单元,配合 Intel® xFasterTransformer 开源框架,实现对 FP16、BF16、INT4 等多精度数据的高效处理。

2. 大模型部署的成本革命

这一性能直接颠覆行业认知:传统部署 671B 参数模型需 8-16 张 GPU,硬件成本超千万元;而单路 6980P 即可独立承载,配合天翼云 c8e 实例,部署成本降低 70% 以上。某金融机构采用该方案构建智能投研助手,不仅推理延迟控制在 200ms 以内,年运维成本较 GPU 集群减少 89 万元。

三、内存体系革新:T 级带宽支撑的算力无瓶颈

Xeon® 6980P 的内存设计针对性解决大模型 “权重加载慢、数据吞吐堵” 的核心痛点,延续了Xeon® 系列对内存性能的极致追求。

1. 多维内存的协同突破

其支持 MRDIMM-8800 高速内存,配合 6 条 24 GT/s 的 UPI 互联链路,实现 “内存 - 缓存 - 芯粒” 的无瓶颈数据流转。504MB 的三级缓存(较第五代 320MB 提升 57%)为 128 核提供充裕的本地数据缓冲,使 DeepSeek-R1 模型的权重加载速度较Xeon® 6348 提升 3.2 倍。单路最大支持 4TB DDR5 内存,可直接存储 671B 模型的全量权重,无需依赖显存虚拟化技术。

2. 分布式场景的扩展能力

在双路部署时,通过 UPI 链路实现 1.44TB/s 的互连带宽,配合 Intel® oneAPI 工具链的分布式优化,可将模型推理性能线性扩展至 28 token/s 以上。某超算中心基于 8 路 6980P 构建的 AI 集群,成功支撑 4 个 671B 模型同时运行,资源利用率较 GPU 集群提升 45%。

四、行业场景适配:从云端到边缘的全栈赋能

Xeon® 6980P 的优势不止于参数,更在于对至强生态的深度继承与升级,实现 “端云协同 + 多场景兼容” 的全链路价值。

1. 端云一体的算力闭环

其能效核技术与 Intel® Core™ Ultra 同源,通过 OpenVINOTM 工具链可实现 “端侧模型调试、云端大规模部署” 的无缝衔接。某设计企业借助该协同,在 Intel® Core™ Ultra 工作站完成 AI 渲染初稿后,上传至 6980P 集群进行 100 + 版本精细化处理,整体效率提升 2.8 倍,云端算力占用减少 80%,延续了 Xeon® 系列 “端云协同” 的战略基因。

2. 垂直行业的精准赋能

在金融领域,其 128 核并行能力使日均千万笔交易的风控模型处理延迟从 50ms 降至 8ms;在科研领域,搭配 xFasterTransformer 框架运行气象模拟模型,计算速度较 Xeon® Platinum 8480H 提升 2.1 倍。这种 “通用算力 + AI 加速” 的双重属性,使其成为继 Xeon® E7、Scalable 系列后,又一款跨行业适配的标杆产品。

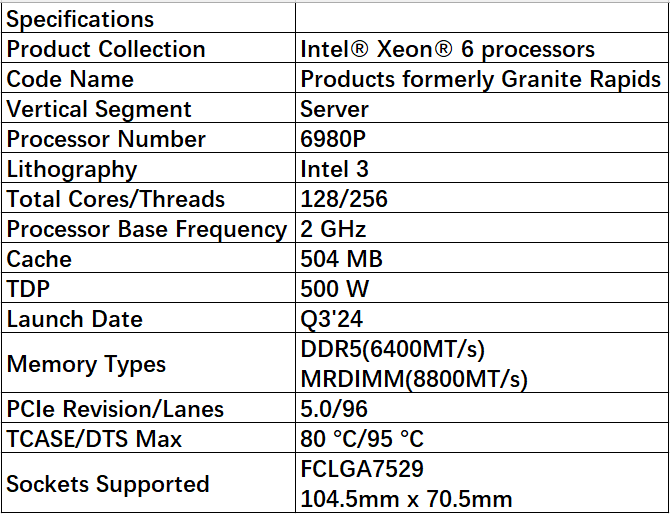

五、Xeon® 6980P 部分参数如下:

结语:CPU 主导 AI 时代的开启者

Xeon® 6980P 的优势本质是 “算力密度、AI 能力、内存性能” 的协同破壁 ——128 核 Chiplet 架构解决 “算力不够用” 的问题,AMX 加速与内存革命解决 “AI 跑不动” 的痛点,端云协同解决 “生态不兼容” 的障碍。它不仅是 Xeon® 系列二十年技术积累的集大成者,更标志着 CPU 从 “通用计算核心” 向 “AI 原生算力枢纽” 的转型。这款处理器正在证明:在 AI 算力竞争中,CPU 并非配角。正如 Xeon® 系列用 QPI 打破 RISC 垄断、用虚拟化支撑云计算,6980P 正用 128 核的力量,开启 “CPU 主导超大规模 AI 推理” 的新时代。